ការវាយប្រហារពីគ្រប់ទិសទី

Google បានដាក់ឱ្យដំណើរការផលិតផលឆ្លាតវៃសិប្បនិម្មិត (AI) ថ្មីមួយដែលមានឈ្មោះថា "Gemini Nano Banana" ដែលមិនមែនជាភាសាធំ AI (LLM) ដែលមានសមត្ថភាពសរសេរ និងហេតុផល ប៉ុន្តែ AI ដែលមានឯកទេសក្នុងការកែរូបថត...

លោក Nguyen Hong Phuc នាយក ផ្នែកវិទ្យាសាស្ត្រ នៅ Conductify AI មានប្រសាសន៍ថា “វាដូចជាការថយក្រោយ” នៃបច្ចេកវិទ្យា និងក្រមសីលធម៌ AI ។ "Gemini Nano Banana មានសមត្ថភាពកែសម្រួលរូបថតប្រកបដោយប្រសិទ្ធភាព។ ប៉ុន្តែការមិនត្រួតពិនិត្យរបស់ Google លើ Gemini Nano Banana ដែលបន្ធូរបន្ថយឧបសគ្គ និងយន្តការកំណត់ អនុញ្ញាតឱ្យ AI នេះបង្កើតរូបភាពដែលមើលទៅស្រដៀងនឹងតារាល្បីៗ រូបភាពសិចស៊ី រូបភាពរសើប..." លោក Phuc បាននិយាយថា។

យោងតាមលោក Nguyen Hong Phuc សមត្ថភាពនេះធ្វើឱ្យ Gemini Nano Banana ជាឧបករណ៍បង្កើតរូបភាពក្លែងក្លាយ ដែលសូម្បីតែអ្នកជំនាញ AI មិនអាចបែងចែកបាន ដែលនាំឱ្យមានហានិភ័យថ្មីនៃការក្លែងបន្លំ និងហានិភ័យសន្តិសុខតាមអ៊ីនធឺណិត ដូចជាការបង្កើតរូបថតជាមួយអ្នកនយោបាយ និង អ្នកនយោបាយ ល្បីៗ ដើម្បីផ្សព្វផ្សាយព័ត៌មានក្លែងក្លាយ សូម្បីតែបុគ្គលក៏មានរូបថតរបស់ពួកគេដែលត្រូវបានកែសម្រួលដោយ AI និងបង្ខូចកេរ្តិ៍ឈ្មោះនៅលើបណ្តាញសង្គម...

លើសពីនេះទៀត ជាមួយនឹងឧបករណ៍ AI កែរូបភាពរាប់សិបផ្សេងទៀត "បង្កើតរលក" តាមអ៊ិនធរណេត ការក្លែងបន្លំជ្រៅមិនមានទីបញ្ចប់ក្នុងការមើលឃើញ។ ស្ថិតិពីអង្គការសន្តិសុខបង្ហាញថា បច្ចេកវិទ្យាក្លែងបន្លំជ្រៅបង្កើតយុទ្ធនាការក្លែងបន្លំដែលផ្តោតលើបុគ្គលដែលមានតម្លៃខ្ពស់ ជាពិសេសអ្នកដឹកនាំអាជីវកម្ម។ នៅឆ្នាំ 2024 មានករណីចំនួន 140,000-150,000 នៅទូទាំងពិភពលោក ដែលក្នុងនោះ 75% បានកំណត់គោលដៅទៅលើ CEO និងថ្នាក់ដឹកនាំជាន់ខ្ពស់... Deepfake អាចបង្កើនការខាតបង់ សេដ្ឋកិច្ច ពិភពលោកចំនួន 32% ប្រហែល 40 ពាន់លានដុល្លារ/ឆ្នាំនៅឆ្នាំ 2027។

ថ្មីៗនេះ ក្រុមហ៊ុន AI Anthropic Company បានរកឃើញ និងទប់ស្កាត់យុទ្ធនាការវាយប្រហារតាមអ៊ីនធឺណិត ដែលធ្វើឡើងដោយពួក Hacker បរទេស ដែលជាលើកដំបូងបានកត់ត្រាការប្រើប្រាស់ AI ដើម្បីសម្របសម្រួលសកម្មភាពវាយប្រហារដោយស្វ័យប្រវត្តិ។ ជាពិសេស ពួក Hacker បានប្រើប្រាស់ប្រព័ន្ធ AI ដើម្បីរៀបចំផែនការ ដឹកនាំ និងដាក់ពង្រាយសកម្មភាពឈ្លានពាន ដែលជាការអភិវឌ្ឍន៍ "គួរឱ្យព្រួយបារម្ភ" ជាមួយនឹងហានិភ័យនៃការពង្រីកទំហំ និងល្បឿននៃយុទ្ធនាការវាយប្រហារតាមអ៊ីនធឺណិត...

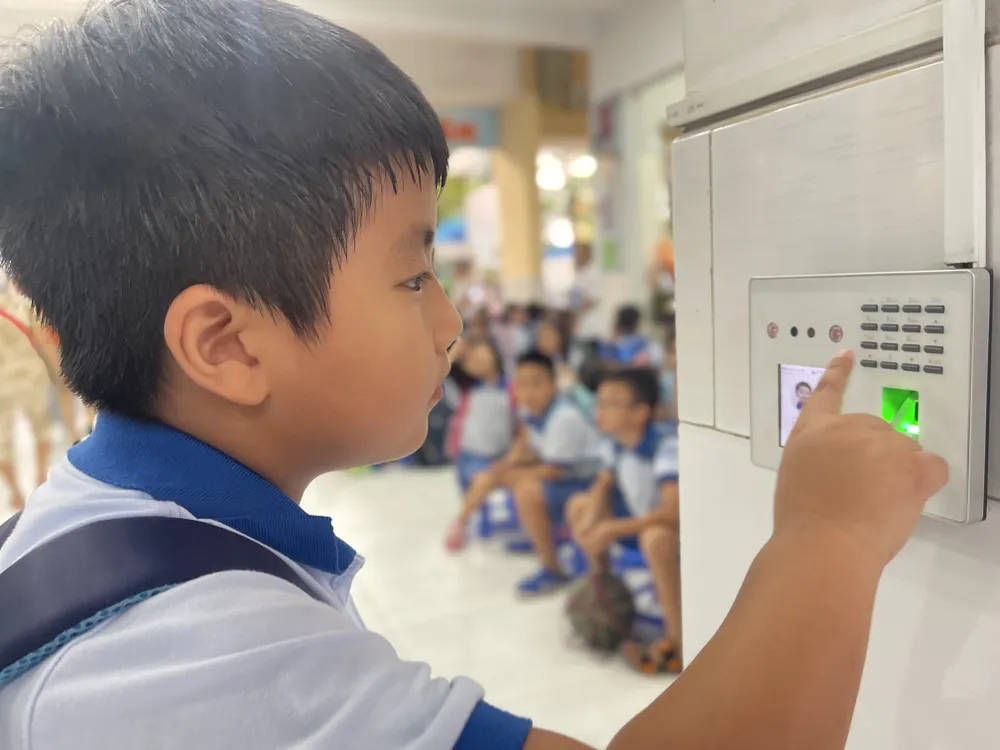

លោក Ngo Minh Hieu នាយកអង្គការប្រឆាំងការក្លែងបន្លំនៃសមាគមសន្តិសុខតាមអ៊ីនធឺណិតជាតិបានចែករំលែកថា ឧបករណ៍រួមបញ្ចូល AI មានល្បឿនក្លែងបន្លំប្រហែល 20 ដងខ្ពស់ជាងការប្រើប្រាស់មនុស្សពិត។ ប្រធានបទផ្តល់សេណារីយ៉ូក្លែងបន្លំទៅ AI សម្រាប់ការវិភាគ ហើយភ្លាមៗនោះប្រព័ន្ធនឹងជជែកដោយស្វ័យប្រវត្តិជាមួយជនរងគ្រោះ។ តាមទិន្នន័យដំបូង AI អាចដឹងពីអ្វីដែលជនរងគ្រោះចង់បាន និងជជែកជាមួយជនរងគ្រោះក្នុងពេលជាក់ស្តែង។ ល្បិចដែលស្មុគ្រស្មាញបំផុតគឺការវាយប្រហារ "Man-in-the-Middle" ដែលមានន័យថានៅពេលដែលអ្នកប្រើប្រាស់ធ្វើការផ្ទៀងផ្ទាត់វីដេអូដូចជា បង្វែរមុខ អានពាក្យបញ្ជា ហេកឃឺនឹងឈរនៅកណ្តាលដើម្បីជ្រៀតជ្រែកទិន្នន័យដែលបានបញ្ជូន។ នៅពេលនោះ ឧក្រិដ្ឋជនតាមអ៊ីនធឺណិតបានបញ្ចូលវីដេអូក្លែងបន្លំជ្រៅដែលបានរៀបចំ ជំនួសការផ្សាយទិន្នន័យពិតរបស់អ្នកប្រើប្រាស់ ដើម្បីចៀសវៀងការផ្ទៀងផ្ទាត់... ជាមួយនឹងវិធីសាស្ត្រខាងលើ ប្រព័ន្ធសុវត្ថិភាពរបស់ធនាគារ និងស្ថាប័នហិរញ្ញវត្ថុក៏ស្ថិតក្នុងហានិភ័យនៃការបោកប្រាស់ផងដែរ។

ការគ្រប់គ្រងទិន្នន័យកាន់តែប្រសើរ

នៅពេលដែល AI កាន់តែមានប្រជាប្រិយភាព ហានិភ័យសុវត្ថិភាព និងឯកជនភាពក៏កើនឡើងយ៉ាងខ្លាំងផងដែរ។ ទិន្នន័យដែលបានរក្សាទុក និងដំណើរការនៅលើម៉ាស៊ីនមេពីចម្ងាយនឹងក្លាយជាគោលដៅដ៏គួរឱ្យទាក់ទាញសម្រាប់ពួក Hacker និងអង្គការឧក្រិដ្ឋជនតាមអ៊ីនធឺណិត។ យោងតាមទិន្នន័យរបស់ National Cyber Security Association ក្នុងត្រីមាសទី 2 ឆ្នាំ 2025 តែមួយប៉ុណ្ណោះ ចំនួននៃការវាយប្រហារតាមអ៊ីនធឺណិតដោយប្រើ AI បានកើនឡើង 62% ដែលបណ្តាលឱ្យមានការខាតបង់ជាសាកលដល់ទៅ 18 ពាន់លានដុល្លារ...

អ្នកជំនាញនិយាយថាការការពារទិន្នន័យមានសារៈសំខាន់ណាស់។ ទោះជាយ៉ាងណាក៏ដោយ ការប្រមូលទិន្នន័យ និងការលក់នៅតែប្រព្រឹត្តទៅដោយបើកចំហនៅលើវេទិកា "ទីផ្សារងងឹត" ជាច្រើន ដោយចំណាយត្រឹមតែ 20 ដុល្លារក្នុងមួយខែ។ ឧក្រិដ្ឋជនតាមអ៊ីនធឺណិតអាចប្រើឧបករណ៍ដែលដំណើរការស្រដៀងទៅនឹងគំរូភាសា ប៉ុន្តែត្រូវបានប្ដូរតាមបំណងសម្រាប់គោលបំណងព្រហ្មទណ្ឌ។ ឧបករណ៍ទាំងនេះមានសមត្ថភាពបង្កើតកូដព្យាបាទ និងសូម្បីតែឆ្លងកាត់កម្មវិធីកម្ចាត់មេរោគ។

នៅប្រទេសវៀតណាម ក្រឹត្យលេខ 13/2023/ND-CP (មានប្រសិទ្ធភាពចាប់ពីថ្ងៃទី 17 ខែមេសា ឆ្នាំ 2023) គ្រប់គ្រងការការពារទិន្នន័យផ្ទាល់ខ្លួន។ លើសពីនេះ ច្បាប់ស្តីពីការការពារទិន្នន័យផ្ទាល់ខ្លួន ត្រូវបានគេរំពឹងថានឹងចូលជាធរមានចាប់ពីថ្ងៃទី 1 ខែមករា ឆ្នាំ 2026 ដោយបើកយន្តការផ្លូវច្បាប់កាន់តែរឹងមាំ ដើម្បីឆ្លើយតបទៅនឹងហានិភ័យនៃការលេចធ្លាយទិន្នន័យផ្ទាល់ខ្លួន និងការរំលោភបំពាន។ ទោះបីជាយ៉ាងណាក៏ដោយ យោងតាមសមាគមសន្តិសុខតាមអ៊ីនធឺណិតជាតិ ប្រសិទ្ធភាពនៃការអនុវត្តនៅតែត្រូវពង្រឹងលើសសរស្តម្ភទាំងបី៖ ការលើកកម្ពស់ការយល់ដឹងរបស់ប្រជាជន ការបង្កើនការទទួលខុសត្រូវអាជីវកម្ម និងការកែលម្អសមត្ថភាពគ្រប់គ្រងរបស់ភ្នាក់ងារគ្រប់គ្រង។ បន្ថែមពីលើវិធានការបច្ចេកទេស មនុស្សម្នាក់ៗត្រូវបង្កើតសមត្ថភាពក្នុងការកំណត់អត្តសញ្ញាណសញ្ញាមិនធម្មតា និងគួរឱ្យសង្ស័យ និងការពារខ្លួនយ៉ាងសកម្មពីអន្តរកម្មឌីជីថលដ៏គ្រោះថ្នាក់...

ក្រុមហ៊ុនសន្តិសុខ Kaspersky បានព្រមានប្រឆាំងនឹងការប្រើប្រាស់ខុសនៃ Dark AI (ពាក្យដែលប្រើដើម្បីពិពណ៌នាអំពីការដាក់ពង្រាយគំរូភាសាធំ (LLMs) ដែលដំណើរការក្រៅការគ្រប់គ្រងសុវត្ថិភាពស្តង់ដារ ដែលជារឿយៗអនុញ្ញាតឱ្យមានសកម្មភាពដូចជាការក្លែងបន្លំ ឧបាយកល ការវាយប្រហារតាមអ៊ីនធឺណិត ឬការរំលោភបំពានទិន្នន័យ)។ ស្ថាប័ន និងបុគ្គលត្រូវត្រៀមលក្ខណៈសម្រាប់ការវាយប្រហារតាមអ៊ីនធឺណិតកាន់តែទំនើប និងពិបាករកឃើញ ដោយសារតែការកើនឡើងនៃ Dark AI នៅក្នុងតំបន់អាស៊ីប៉ាស៊ីហ្វិក។

លោក Sergey Lozhkin ប្រធានក្រុមស្រាវជ្រាវ និងវិភាគសកល (GReAT) ទទួលបន្ទុកតំបន់មជ្ឈិមបូព៌ា ទួរគី អាហ្វ្រិក និងតំបន់អាស៊ីប៉ាស៊ីហ្វិកនៅ Kaspersky បានចែករំលែកថា ការបង្ហាញមួយនៃការរំលោភបំពាន AI នាពេលបច្ចុប្បន្ននេះគឺការលេចឡើងនៃម៉ូដែល Black Hat GPT ។ ទាំងនេះគឺជាគំរូ AI ដែលត្រូវបានបង្កើតឡើងជាពិសេស ឬកែសម្រួលដើម្បីបម្រើគោលបំណងគ្មានសីលធម៌ និងខុសច្បាប់ ដូចជាការបង្កើតមេរោគ ការធ្វើសេចក្តីព្រាងអ៊ីមែលបន្លំយ៉ាងស្ទាត់ជំនាញ និងគួរឱ្យជឿជាក់ខ្ពស់ ដើម្បីបម្រើការវាយប្រហារទ្រង់ទ្រាយធំ បង្កើតសំឡេង និងវីដេអូក្លែងបន្លំជ្រៅ ហើយថែមទាំងគាំទ្រដល់ប្រតិបត្តិការវាយប្រហារក្លែង...

អ្នកជំនាញ Kaspersky ណែនាំថាបុគ្គល និងអាជីវកម្មប្រើប្រាស់ដំណោះស្រាយសុវត្ថិភាពជំនាន់ក្រោយ ដើម្បីស្វែងរកមេរោគដែលបង្កើតដោយ AI និងកំណត់អត្តសញ្ញាណការការពារទិន្នន័យជាគោលដៅសំខាន់មួយ។ សម្រាប់អាជីវកម្ម ចាំបាច់ត្រូវអនុវត្តឧបករណ៍ត្រួតពិនិត្យតាមពេលវេលាជាក់ស្តែង ដើម្បីតាមដានការកេងប្រវ័ញ្ចដែលជំរុញដោយ AI ។ ពង្រឹងការគ្រប់គ្រងការចូលប្រើ និងការបណ្តុះបណ្តាលបុគ្គលិកដើម្បីកំណត់បាតុភូតនៃ AI នៅក្នុងទីងងឹត ក៏ដូចជាហានិភ័យនៃការលេចធ្លាយទិន្នន័យ។ បង្កើតមជ្ឈមណ្ឌលប្រតិបត្តិការសន្តិសុខតាមអ៊ីនធឺណិត ដើម្បីតាមដានការគំរាមកំហែង និងឆ្លើយតបយ៉ាងឆាប់រហ័សចំពោះឧប្បត្តិហេតុ...

ប្រភព៖ https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[រូបថត] នាយករដ្ឋមន្ត្រី Pham Minh Chinh និងភរិយាជួបសហគមន៍វៀតណាមនៅអាល់ហ្សេរី](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/19/1763510299099_1763510015166-jpg.webp)

![[រូបថត] អគ្គលេខាធិកា To Lam ទទួលជួបឧបនាយករដ្ឋមន្ត្រី និងជារដ្ឋមន្ត្រីក្រសួងការពារជាតិស្លូវ៉ាគី លោក Robert Kalinak](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/18/1763467091441_a1-bnd-8261-6981-jpg.webp)

Kommentar (0)